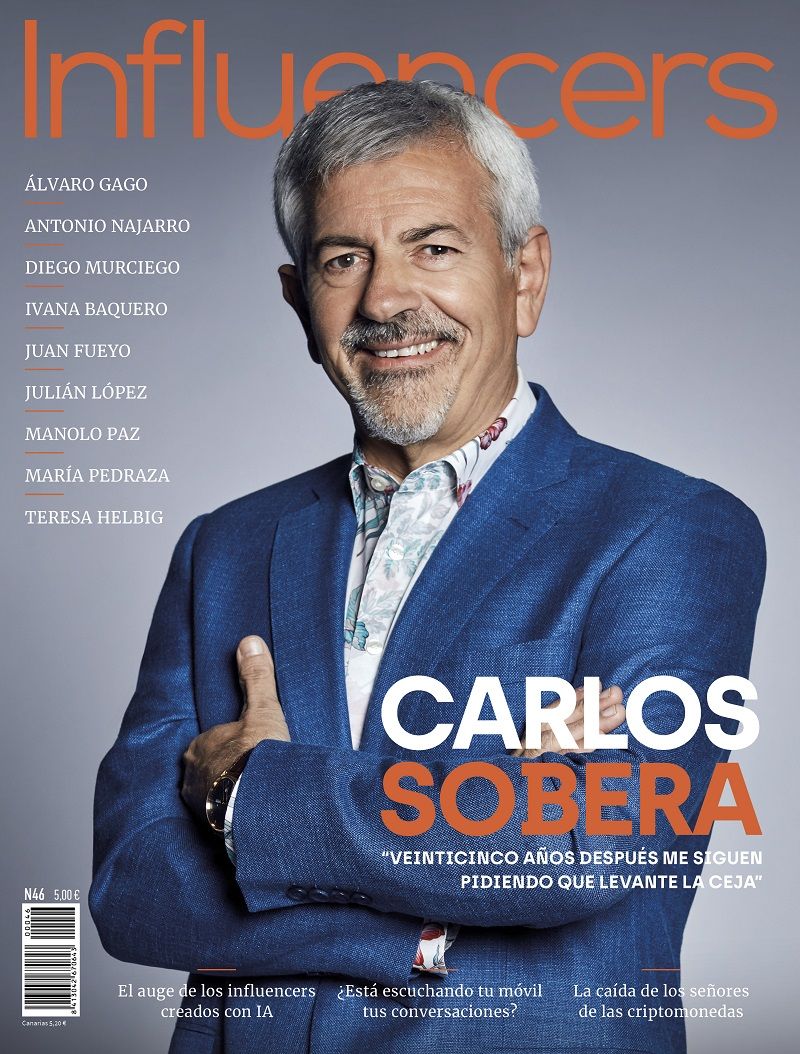

Inteligencia Artificial: así está escapando al control del hombre y amenaza a la humanidad

En las últimas décadas, la humanidad ha mirado con cierto miedo a la inmensidad del universo pensando que, tal vez, una civilización avanzada pueda acabar con nosotros. Pero curiosamente, salvo un descubrimiento histórico, el verdadero peligro para la vida humana no está tan lejos, sino mucho más cerca. Más en concreto, se trata de una creación propia llamada Inteligencia Artificial (IA). Un término ampliamente conocido que, sin embargo, esconde un reverso oscuro “impredecible” que asusta a todos.

En ese sentido apocalíptico se encuadra la ya famosa carta abierta firmada por, entre otros, Elon Musk, Steve Wozniak (co-fundador de Apple), Jaan Tallinn (co-fundador de Skype) y Max Tegmark (MIT). Un escrito que contiene una conclusión principal: “Pedimos a todos los laboratorios de Inteligencia Artificial (IA) que pausen inmediatamente durante al menos 6 meses el entrenamiento de sistemas de IA más potentes que GPT-4”. Pero ¿a qué se refieren algunas de las mentes más brillantes de nuestro tiempo? ¿Qué es eso de parar el entrenamiento? ¿Por qué se hace referencia a chat GPT-4?

Las preguntas son muchas, y todas son importantes, pero la respuesta rápida a todo ello es que buscan frenar el advenimiento de la llamada SuperInteligencia Artificial (ASI, por sus siglas en inglés). Un tipo de tecnología que sería capaz de concebir un tipo de conciencia propia, similar al de un ser vivo, que de crearse cambiaría para siempre a la civilización humana. Y, lo que es más intrigante, cuyo nacimiento podría ser espontáneo, lo que dificulta su control.

LA INTELIGENCIA ARTIFICIAL HA ENTRADO EN UNA NUEVA FASE

La inteligencia artificial es un concepto que no termina de quedar claro en el subconsciente humano. Así, para la mayoría se trata de un término relativamente nuevo -la RAE lo calificó como “palabra del año” en 2022-, abstracto y ficticio. Tampoco es culpa nuestra, al fin y al cabo, la asociamos más a las películas, como la Guerra de las Galaxias, o incluso la asemejamos a los robots, por culpa de referencias cinéfilas como Terminator. Pero nada más lejos de la realidad, la IA lleva décadas con nosotros y no tiene nada que ver con la robótica (como mucho, el símil de cerebro y cuerpo).

Entonces, ¿por qué ahora todo el mundo está entrando en pánico? La respuesta es que la IA ha mutado sin que nos hayamos dado mucha cuenta, al menos, el público en general. Hasta hace relativamente poco, la IA con la que trabajaban los científicos era de un tipo básico denominada IA Estrecha. Ese tipo de tecnología, como nuestro SIRI, es capaz de acatar órdenes sencillas, pero no se le puede pedir (pese a las mejoras introducidas) otras acciones que requieran un mayor razonamiento.

Obviamente, ese tipo de IA no es peligrosa. Pero un hallazgo en 2017 lo cambió todo. Hasta entonces, los programas de IA utilizaban lo que se llamaba red neuronal recurrente, pero a partir de un descubrimiento de los investigadores de Google se empezó a utilizar lo se conoce como transformadores. La diferencia entre uno y otro es enorme, ya que mientras que una red recurrente analiza una oración palabra por palabra, el transformador procesa todas las palabras al mismo tiempo, al mismo tiempo que las relaciona.

EL PODER “IMPREDECIBLE” DE LA IA

En otras palabras, la IA puede ‘razonar’ en cierto sentido al comprender la información en su conjunto, en lugar de estudiarla de forma separada. Ese enorme salto, junto al ingente volumen de datos con el que los científicos alimentan a dichos algoritmos, es lo que ha ayudado a crear, por ejemplo, a Chat GPT y al resto de algoritmos que ahora conocemos como modelos de lenguaje grande (LLP, por sus siglas en inglés). Sus desarrollos son todavía pequeños, pero a medida que siguen absorbiendo y estudiando datos cada vez se hacen mayores.

Eso está haciendo que estemos a las puertas de obtener una Inteligencia Artificial General (AGI), que también se denominan IA Fuerte o IA nivel humano, la cual es tan inteligente como una persona y es capaz de razonar, planificar, resolver problemas, pensar de manera abstracta, comprender ideas complejas y aprender de la experiencia. ¿Estamos cerca de lograr esto? La respuesta a priori es que todavía no, pero no es una respuesta segura al 100%, ya que los actuales LLP han empezado a desarrollar capacidades impredecibles para los que no han sido entrenados, por lo que podríamos estar mucho más cerca de lo que se piensa.

Así, investigaciones recientes han revelado que los LLM pueden producir cientos de habilidades «emergentes», tareas que los modelos grandes pueden completar y los modelos más pequeños no, y que poco tienen que ver con el análisis de texto. Esos estudios van más allá, ya que sugieren que para algunas tareas y algunos modelos existe un umbral de complejidad más allá del cual la funcionalidad del modelo se dispara, lo que implica un reverso oscuro.

LA SUPERINTELIGENCIA ARTIFICIAL, UN DIOS EN LA TIERRA

Al final, si este tipo de algoritmos enormes se siguen alimentando de forma descontrolada, nadie sabe lo que puede acabar generando, ya que en algunos casos se ha traspasado el nivel de complejidad en el que las habilidades impredecibles empiezan a aparecer sin ningún tipo de control. De ahí, por ejemplo, que los ilustres firmantes de la carta abierta anteriormente citada se centren en detener por el momento la evolución de Chat GPT-3 (Chat GPT-4), el modelo LLP más complejo que hay.

El final del camino es todavía más inquietante. Así, uno de esos saltos esporádicos puede terminar generando una Superinteligencia Artificial (ASI). En ese momento, la humanidad, como raza, podría pender de un hilo. Además, podría no tardar tanto en llegar como puede parecer; al fin y al cabo, si un sistema es suficientemente complejo entraría en juego lo que se conoce como superación personal recursiva. En pocas palabras: si tenemos un algoritmo diseñado con el objetivo de mejorar su propia inteligencia a medida que mejora, los saltos hacía adelante son mayores hasta que se vuelven increíblemente grandes. A eso se le conoce como ‘Explosión de Inteligencia’ y es el último ejemplo de la llamada Ley de rendimientos acelerados.

Por desgracia, la superinteligencia de la que hablamos es casi imposible imaginársela, al igual que si Dios existe no somos capaces de concebirlo realmente. Piense por un momento en nuestro entorno: vivimos en una sociedad en la que un cociente intelectual (CI) de 130 es considerado brillante, pero no podemos ser capaces de imaginar un organismo con un CI de 10.000 o 12.000. Simplemente no podemos pensar en ello. Pero que se pueda generar algo así no parece nada descabellado, es algo real.

De hecho, la vida misma nació así, cuando colectivos autoorganizados e inertes empezaron a tener comportamientos emergentes. Las combinaciones de átomos sin vida dan lugar a células vivas, y las células hacen que los músculos se muevan y los corazones latan. Hasta ahora, no se había podido encontrar entes autoorganizados tan relacionados y tan grandes como los LLP, por lo que lo que ocurra de ahora en adelante no solo es impredecible, sino que está cerca de escaparse del control de los humanos.